Nell’era moderna, la crescita dell’intelligenza artificiale generativa ha attirato l’attenzione di molte aziende. Questa tecnologia promette una miriade di opportunità in termini di innovazione e produttività, ma con soluzioni offerte dall’AI generativa arrivano anche rischi e sfide. Una delle principali preoccupazioni per le aziende è come ridurre al minimo la perdita o il furto di dati. Ispirandoci alle idee e alle osservazioni di Torsten Grabs, Senior Director of Product Management di Snowflake, abbiamo deciso di approfondire questa tematica per offrire una panoramica più dettagliata delle sfide e delle soluzioni nel campo dell’IA generativa. Snowflake è una società di cloud data basata sul cloud computing.

AI generativa: i rischi e le potenzialità di questa tecnologia

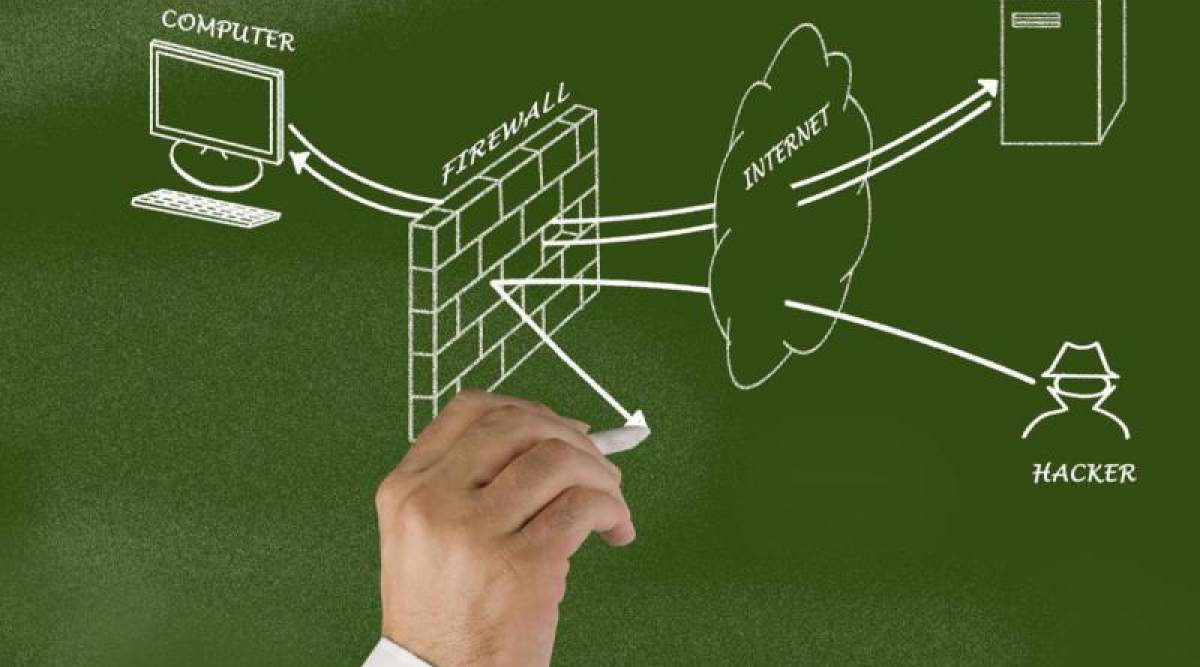

Il potenziale degli LLM (modelli linguistici di grandi dimensioni) è innegabile, ma il loro utilizzo in cloud pubblici introduce questioni cruciali di sicurezza, privacy e governance. La preoccupazione legittima delle aziende è che questi modelli possano assorbire, apprendere e potenzialmente divulgare informazioni sensibili a terzi. Questo rischio è particolarmente elevato per le aziende in settori altamente regolamentati. Per risolvere questo problema, una soluzione promettente è di portare l’LLM ai dati piuttosto che viceversa. Questo si traduce nell’incorporare i modelli linguistici all’interno del perimetro di sicurezza aziendale, garantendo una protezione delle informazioni personali identificabili (PII) e altre informazioni sensibili. Questo ambiente protetto non solo garantisce una maggiore sicurezza, ma consente anche una personalizzazione e un’interazione più sicura con i modelli.

Tuttavia, per trarre il massimo vantaggio dagli LLM, le aziende devono assicurarsi di avere una strategia dati solida e coerente. Questa strategia implica la rottura dei silos dati, in favore di politiche semplici e coerenti che consentano ai team di accedere ai dati di cui hanno bisogno. L’obiettivo finale è quello di garantire un accesso semplificato e regolamentato dei dati. Ancora più cruciale è la necessità di personalizzare e specializzare gli LLM. A causa delle limitazioni dei modelli generici disponibili al pubblico, è fondamentale esplorare modelli specializzati, che siano in grado di garantire tutta la privacy possibile. Alcuni di questi modelli come StarCoder di Hugging Face o StableLM di StabilityAI, addestrandoli sui dati interni riescono a garantire precisione e affidabilità.

L’importanza dei dati non strutturati per l’AI multi-modale

L’implementazione di un modello basato su sistemi e dati interni richiede l’accesso a tutte le informazioni utili a tale scopo, e molte di queste verranno archiviate in formati diversi dal normale testo. Circa l’80% dei dati mondiali è in un formato “non strutturato”, e comprende informazioni aziendali quali e-mail, immagini, contratti, e video formativi. Questi formati richiedono tecnologie ad esempio l’elaborazione del linguaggio naturale per estrarre informazioni utili e renderle disponibili ai data scientist. Coloro che analizzeranno i dati utilizzeranno quest’ultimi per addestrare modelli di intelligenza artificiale multi-modale in grado di far emergere le relazioni tra differenti tipi di dati e di evidenziare gli insight più rilevanti.

È importante per le aziende procedere con consapevolezza e cautela, proprio perché l’AI generativa è un mondo in rapida evoluzione. Questo comporta leggere attentamente le clausole dei modelli e dei servizi che si intende adottare e lavorare con fornitori affidabili che offrono garanzie concrete. Si tratta di un settore in cui le aziende non si possono permettere di restare ferme e non esplorare. L’AI generativa comporta dei rischi, ma anche tanti benefici, è importante trovare l’equilibro tra questi due fronti e cogliere l’opportunità per nuove offerte e una crescita aziendale.

- Editore: Bollati Boringhieri

- Autore: Piero Angela , Stefano Quintarelli

- Collana: Saggi

- Formato: Libro in brossura

- Anno: 2020

Rimani aggiornato seguendoci su Google News!

Da non perdere questa settimana su Techbusiness

🔝LinkedIn pubblica il report Top Companies Italia 2024: al primo posto Intesa Sanpaolo

🍪Il futuro della privacy online: Google dice addio ai cookie di terze parti

🪪Parliamo di SASE: intervista a Aldo Di Mattia di Fortinet

💡AMD e i data center energeticamente sostenibili. Intervista ad Alexander Troshin

✒️ La nostra imperdibile newsletter Caffellattech! Iscriviti qui

🎧 Ma lo sai che anche Fjona ha la sua newsletter?! Iscriviti a SuggeriPODCAST!

📺 Trovi Fjona anche su RAI Play con Touch - Impronta digitale!

💌 Risolviamo i tuoi problemi di cuore con B1NARY

🎧 Ascolta il nostro imperdibile podcast Le vie del Tech

💸E trovi un po' di offerte interessanti su Telegram!